там Lex Sokolin в своей рассылке рассуждает как блокчейн/machine economy для физического мира вытекает из и софтверных AI агентов, и идущей цифровизацией физического мира

How Decentralized Physical Infrastructure (DePIN) impacts finance and the machine economy

How Decentralized Physical Infrastructure (DePIN) impacts finance and the machine economy

👍1

Forwarded from Evening Prophet

Media is too big

VIEW IN TELEGRAM

Первый пошел! Промышленные андроиды сингапурской фирмы Fourier Intelligence поступят на рынок к концу года

https://newatlas.com/robotics/fourier-tesla-humanoid-videos/

https://newatlas.com/robotics/fourier-tesla-humanoid-videos/

👍3

Forwarded from Цифры о Стартапах

Какой путь прошли основатели перед созданием компании-единорога?

Сегодня много цифр в исследовании:

https://vc.ru/story/852859

Сегодня много цифр в исследовании:

https://vc.ru/story/852859

👍6

Forwarded from e/acc

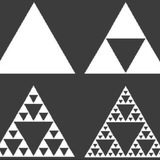

Интернет всполошился. Вчера вышел 166-страничный репорт о возможностях GPT-4V. Оказалось, что GPT не только помножил на ноль почти все продукты в области NLP за последние годы, но и с ноги ворвался в Computer Vision, где сидели бородатые завсегдатаи, пили пиво и были уверены что "уж нас-то ваши эти трансформеры не тронут" (с).

Оказалось, что помимо простого "опиши что на картинке" GPT имеет глубокое понимание визуального и текстового контекста. Умеет определять темпоральный контекст. Знает как распознать и корректно идентифицировать эмоции людей. Прекрасно решает взиуальные логические задачи. Ставит корректные диагнозы по КТ и МРТ снимкам. Может дообучаться, в том числе на few-shot примерах прямо в промте. Анализирует графики. Распознает ингредиенты в блюде. Распознает конкретных людей. Понимает схемы, диаграммы, формулы, в том числе нарисованные от руки. Умеет выполнять навигацию по графическим элементам дизайна. Умеет принимать решения о навигации робота в реальном мире по двухмерной фотографии.

Но, главное, это вообще не какая-то другая модель. Это часть GPT-4 и, соотвественно, все что уже работает внутри GPT (промтинг, RAG, агенты) автоматически работает и для GPT-4V.

Для меня этот пейпер звучит как дикая фантастика 20-летней перспективы. Если бы OpenAI не анонсировал, что продукт будет доступен всем через месяц. А многие в твиттере уже имеют к нему доступ.

Вот тут Леша из Ai Happens рассказывает о примерах для бизнеса, а Сергей из Метаверсище и ИИще про кейсы в психологии и эмоциальном интеллекте.

Оказалось, что помимо простого "опиши что на картинке" GPT имеет глубокое понимание визуального и текстового контекста. Умеет определять темпоральный контекст. Знает как распознать и корректно идентифицировать эмоции людей. Прекрасно решает взиуальные логические задачи. Ставит корректные диагнозы по КТ и МРТ снимкам. Может дообучаться, в том числе на few-shot примерах прямо в промте. Анализирует графики. Распознает ингредиенты в блюде. Распознает конкретных людей. Понимает схемы, диаграммы, формулы, в том числе нарисованные от руки. Умеет выполнять навигацию по графическим элементам дизайна. Умеет принимать решения о навигации робота в реальном мире по двухмерной фотографии.

Но, главное, это вообще не какая-то другая модель. Это часть GPT-4 и, соотвественно, все что уже работает внутри GPT (промтинг, RAG, агенты) автоматически работает и для GPT-4V.

Для меня этот пейпер звучит как дикая фантастика 20-летней перспективы. Если бы OpenAI не анонсировал, что продукт будет доступен всем через месяц. А многие в твиттере уже имеют к нему доступ.

Вот тут Леша из Ai Happens рассказывает о примерах для бизнеса, а Сергей из Метаверсище и ИИще про кейсы в психологии и эмоциальном интеллекте.

🔥5❤2🤔1

Forwarded from e/acc

Интернет встрепенулся (второй раз за день). GPT-4V забыт как детский сон. Open X (коллаборация 21 топовых университетов) дропнули пейпер и гигамодель для генерализации "воплощения" (embodiement) роботов.

Подобно тому как обучение на триллионах токенов создало универсальный NLP алгоритм (LLM), а обучение на терабайтах картинок создало универсальный графическую модель, теперь тот же принцип был успешно применён к робототехнике в новой модели RT-X.

Раньше ИИ модели создавали кастомно под задачи робота (управлять машиной, складывать детали, готовить еду, копать ямы). Здесь представлена модель, которая универсально управляет роботическими руками и умеет выполнять 1,5 миллиона отдельных задач без ручного обучения каждой из них. Роботы, не видевшие раньше задания, такие как "сложи", "возьми", "отсортируй", "налей", "переверни", "открой дверь", "подмети за собой" с первой попытки успешно их выполняют.

Если GPT — это генерализация логических и когнтивных задач (операций с битами), то эта штука — генерализация задач взаимодействия с физическим миром (операций с атомами). В робо-руках, управляемых RT-X, проявились эмерджентные свойства и умение выполнять задачи, которыми их не тренировали. Подобно тому как GPT может ответить на вопрос, который он никогда не видел. Технически это называется "cross-embodiment learning". Модель, кстати, с открытым кодом. Но, как мы знаем, все что Open рано или поздно становится не очень.

Так что, let's fuuucking go, hail to your robot overlords.

Подобно тому как обучение на триллионах токенов создало универсальный NLP алгоритм (LLM), а обучение на терабайтах картинок создало универсальный графическую модель, теперь тот же принцип был успешно применён к робототехнике в новой модели RT-X.

Раньше ИИ модели создавали кастомно под задачи робота (управлять машиной, складывать детали, готовить еду, копать ямы). Здесь представлена модель, которая универсально управляет роботическими руками и умеет выполнять 1,5 миллиона отдельных задач без ручного обучения каждой из них. Роботы, не видевшие раньше задания, такие как "сложи", "возьми", "отсортируй", "налей", "переверни", "открой дверь", "подмети за собой" с первой попытки успешно их выполняют.

Если GPT — это генерализация логических и когнтивных задач (операций с битами), то эта штука — генерализация задач взаимодействия с физическим миром (операций с атомами). В робо-руках, управляемых RT-X, проявились эмерджентные свойства и умение выполнять задачи, которыми их не тренировали. Подобно тому как GPT может ответить на вопрос, который он никогда не видел. Технически это называется "cross-embodiment learning". Модель, кстати, с открытым кодом. Но, как мы знаем, все что Open рано или поздно становится не очень.

Так что, let's fuuucking go, hail to your robot overlords.

🔥3👍2

Forwarded from Перлы постсоветских врачей и психологов

Немного об уроках истории.

Если кто не знал -- к началу 1943 года у США и Британии было настолько мало запасов пенициллина, что провести формальные клинические испытания его на человеке не представлялось возможным. Даже более того -- для спасения жизни первой американской пациентки, которая успешно испытала на себе пенициллин (у неё был сепсис после криминального аборта), была израсходована ПОЛОВИНА всех тогдашних запасов пенициллина в США. А доставляли пенициллин из университетской лаборатории к месту лечения той пациентки в госпитале -- под вооружённой охраной 🙂

И вот, на фоне войны американская FDA пошла на абсолютно беспрецедентное для себя решение -- вопреки собственным же бюрократическим правилам, FDA в начале 1943 года выдала пенициллину регистрацию без формальных клинических испытаний, только лишь на основании всего нескольких известных тогда случаев, когда пенициллин спасал жизнь пациентам с сепсисом или раневой инфекцией.

А потом, тоже в начале 1943 года, был такой эпизод. Президент Рузвельт собрал у себя глав примерно 20 крупнейших на тот момент фармацевтических компаний США и Британии -- Merck, Pfizer, Abbott, Bristol Myers и т.д. И произнес перед ними речь, в которой сказал: "Америка и союзники должны победить. Демократия должна победить. Но чтобы выиграть эту войну -- нам нужен пенициллин. Нам нужно очень много пенициллина. Американское государство готово платить вам -- всем, кто возьмется за его производство -- двадцать тысяч долларов за каждый флакон пенициллина, за каждый миллион единиц".

В итоге -- почти все доступные производственные площади всех двадцати фармкомпаний-участников The Penicillin Group -- были заставлены огромными чанами с пенициллиновой плесенью. А их штатные учёные 7 дней в неделю, без выходных и праздников, занимались селекцией более производительных штаммов плесени.

Уже к июню 1943 года пенициллина было столько, что армия США снизила закупочную цену на него с 20 тысяч баксов за флакон 1 млн единиц -- до 200 баксов за флакон. А к 1945 году -- до 20 центов за флакон 🙂

Это к вопросу о сегодняшних попискиваниях антиваксеров — мол, "вакцины от ковида были недостаточно плотно испытаны". А пенициллин ВООБЩЕ не был формально испытан на момент регистрации (РКИ провели уже потом, в спокойной послевоенной обстановке). И что? 😊

Если кто не знал -- к началу 1943 года у США и Британии было настолько мало запасов пенициллина, что провести формальные клинические испытания его на человеке не представлялось возможным. Даже более того -- для спасения жизни первой американской пациентки, которая успешно испытала на себе пенициллин (у неё был сепсис после криминального аборта), была израсходована ПОЛОВИНА всех тогдашних запасов пенициллина в США. А доставляли пенициллин из университетской лаборатории к месту лечения той пациентки в госпитале -- под вооружённой охраной 🙂

И вот, на фоне войны американская FDA пошла на абсолютно беспрецедентное для себя решение -- вопреки собственным же бюрократическим правилам, FDA в начале 1943 года выдала пенициллину регистрацию без формальных клинических испытаний, только лишь на основании всего нескольких известных тогда случаев, когда пенициллин спасал жизнь пациентам с сепсисом или раневой инфекцией.

А потом, тоже в начале 1943 года, был такой эпизод. Президент Рузвельт собрал у себя глав примерно 20 крупнейших на тот момент фармацевтических компаний США и Британии -- Merck, Pfizer, Abbott, Bristol Myers и т.д. И произнес перед ними речь, в которой сказал: "Америка и союзники должны победить. Демократия должна победить. Но чтобы выиграть эту войну -- нам нужен пенициллин. Нам нужно очень много пенициллина. Американское государство готово платить вам -- всем, кто возьмется за его производство -- двадцать тысяч долларов за каждый флакон пенициллина, за каждый миллион единиц".

В итоге -- почти все доступные производственные площади всех двадцати фармкомпаний-участников The Penicillin Group -- были заставлены огромными чанами с пенициллиновой плесенью. А их штатные учёные 7 дней в неделю, без выходных и праздников, занимались селекцией более производительных штаммов плесени.

Уже к июню 1943 года пенициллина было столько, что армия США снизила закупочную цену на него с 20 тысяч баксов за флакон 1 млн единиц -- до 200 баксов за флакон. А к 1945 году -- до 20 центов за флакон 🙂

Это к вопросу о сегодняшних попискиваниях антиваксеров — мол, "вакцины от ковида были недостаточно плотно испытаны". А пенициллин ВООБЩЕ не был формально испытан на момент регистрации (РКИ провели уже потом, в спокойной послевоенной обстановке). И что? 😊

❤3🕊3😁1🤯1🤡1

Forwarded from Наука всегда кстати

Нобелевская неделя продолжается.

Лауреатами по физике стали Пьер Агостини, Ференц Крауз и Анн Л’Юйе за экспериментальную разработку технологии сверхкоротких лазерных импульсов, позволяющей заглянуть внутрь атома.

В 2001 году будущие лауреаты независимо друг от друга провели успешные эксперименты, которые фактически заложили основу нового научного направления - аттосекундной физики.

⏱ Аттосекунда - одна триллионная доля секунды (10 в минус 18 степени секунды). Как поясняет сам Нобелевский комитет, в секунде столько аттосекунд, сколько секунд в истории вселенной (да, в сложно поверить, но факт остаётся фактом). Именно в таких крошечных промежутках времени в материи происходят процессы на уровне атомов и электронов.

Агостини, Крауз и Л'Юйе создали технологию, позволяющую генерировать сверхкороткие лазерные импульсы, позволяющие зафиксировать взаимодействия между отдельными элементарными частицами, то есть фактически заглянуть внутрь атома. В 2003, например, группа Л’Юилье установила рекорд, создав самый маленький лазерный импульс длиной всего 170 аттосекунд.

"Мы можем теперь открыть дверь в мир электронов. Аттосекундная физика дает нам возможность понять механизмы, которыми управляют электроны. Следующий шаг – их использование", - отмечает председатель Нобелевского комитета по физике Ева Олссон.

Лауреатами по физике стали Пьер Агостини, Ференц Крауз и Анн Л’Юйе за экспериментальную разработку технологии сверхкоротких лазерных импульсов, позволяющей заглянуть внутрь атома.

В 2001 году будущие лауреаты независимо друг от друга провели успешные эксперименты, которые фактически заложили основу нового научного направления - аттосекундной физики.

⏱ Аттосекунда - одна триллионная доля секунды (10 в минус 18 степени секунды). Как поясняет сам Нобелевский комитет, в секунде столько аттосекунд, сколько секунд в истории вселенной (да, в сложно поверить, но факт остаётся фактом). Именно в таких крошечных промежутках времени в материи происходят процессы на уровне атомов и электронов.

Агостини, Крауз и Л'Юйе создали технологию, позволяющую генерировать сверхкороткие лазерные импульсы, позволяющие зафиксировать взаимодействия между отдельными элементарными частицами, то есть фактически заглянуть внутрь атома. В 2003, например, группа Л’Юилье установила рекорд, создав самый маленький лазерный импульс длиной всего 170 аттосекунд.

"Мы можем теперь открыть дверь в мир электронов. Аттосекундная физика дает нам возможность понять механизмы, которыми управляют электроны. Следующий шаг – их использование", - отмечает председатель Нобелевского комитета по физике Ева Олссон.

🕊4😁3👍2

Forwarded from [Другая]стратегия (Natallia Andreeva)

#про_ИИ #про_науку

Внезапно кул стори про разницу между ИИ-хайпом и суровой реальностью. Помните, пару лет назад был страшный кипеш по поводу гугловского AlphaFold'a, который [предположительно] решил эпохальную проблему свёртывания белков?

Собственно, это была первая заметная (читай - запущенная вендорами) волна хайпа по поводу генеративного ИИ: хоронили всех структурных биологов чохом; пророчили революцию в медицине - в общем, было всё то же, что нынче с ChatGPT.

А когда информационная пена осела, оказалось, что:

1️⃣ Реальная проблема фолдинга белков - не в предсказании формы, как рассказывает всем Google (и прочие товарищи в полосатых купальниках, продающие генеративный ИИ); реальная проблема - в предсказании функции получившегося белка. Ну потому что если вы не знаете, что этот белок делает, то зачем козе этот баян, кроме как на побаловаться.

2️⃣ Сомнительная польза AlphaFold в этой части связана с тем, что ИИ не обучен анализировать связывание лигандов; проще говоря - не работает с межмолекулярными взаимодействиями белок / рецептор, которые, собственно, и определяют производимые эффекты (физиологические, биохим и пр.). Можно ли его вообще этому обучить, вопрос открытый; вероятно, можно, но пока этого не произошло.

3️⃣ Результаты работы AlphaFold невозможно толком проверить - моделей слишком много; а до тех пор, пока статистически значимое количество моделей не будет проверено в пробирке, ничего утверждать нельзя - и лучше бы ничего из этого не продавать медикам и фармацевтам (кстати, по итогам того, что успели проверить, высокоточными оказались примерно 35% полученных моделей; не говоря уже о том, что IRL существует больше типов белков, чем те, на которых его обучили: в модели, например, не учтены микробные белки, - и как с этим жить, тоже пока не понятно).

4️⃣ И вишенка на торте: все эти прекрасные результаты (тм) были получены только потому, что Google DeepMind тупо использовал открытую базу данных по белковым последовательностям UniProt, которую международный консорциум биотех-институтов кропотливо собирал аж с 1986 года. Так что не удивительно, что бедный Google вынужден был сделать AlphaFold общедоступным; попробуй он его продать, его бы с потрохами сожрали.

Учёные - люди очень вежливые, и никто, если я правильно помню, публично и нецензурно на эту тему не высказался. Но на конференциях и прочих проф обсуждениях биологи периодически делают 🤦🏻♀️🤦🏻♀️🤦🏻♀️. Правда, тут же добавляя, что AlphaFold - это хорошо, это первый шаг ТМ и прочее в том же духе.

Люблю такое.

Внезапно кул стори про разницу между ИИ-хайпом и суровой реальностью. Помните, пару лет назад был страшный кипеш по поводу гугловского AlphaFold'a, который [предположительно] решил эпохальную проблему свёртывания белков?

Собственно, это была первая заметная (читай - запущенная вендорами) волна хайпа по поводу генеративного ИИ: хоронили всех структурных биологов чохом; пророчили революцию в медицине - в общем, было всё то же, что нынче с ChatGPT.

А когда информационная пена осела, оказалось, что:

1️⃣ Реальная проблема фолдинга белков - не в предсказании формы, как рассказывает всем Google (и прочие товарищи в полосатых купальниках, продающие генеративный ИИ); реальная проблема - в предсказании функции получившегося белка. Ну потому что если вы не знаете, что этот белок делает, то зачем козе этот баян, кроме как на побаловаться.

2️⃣ Сомнительная польза AlphaFold в этой части связана с тем, что ИИ не обучен анализировать связывание лигандов; проще говоря - не работает с межмолекулярными взаимодействиями белок / рецептор, которые, собственно, и определяют производимые эффекты (физиологические, биохим и пр.). Можно ли его вообще этому обучить, вопрос открытый; вероятно, можно, но пока этого не произошло.

3️⃣ Результаты работы AlphaFold невозможно толком проверить - моделей слишком много; а до тех пор, пока статистически значимое количество моделей не будет проверено в пробирке, ничего утверждать нельзя - и лучше бы ничего из этого не продавать медикам и фармацевтам (кстати, по итогам того, что успели проверить, высокоточными оказались примерно 35% полученных моделей; не говоря уже о том, что IRL существует больше типов белков, чем те, на которых его обучили: в модели, например, не учтены микробные белки, - и как с этим жить, тоже пока не понятно).

4️⃣ И вишенка на торте: все эти прекрасные результаты (тм) были получены только потому, что Google DeepMind тупо использовал открытую базу данных по белковым последовательностям UniProt, которую международный консорциум биотех-институтов кропотливо собирал аж с 1986 года. Так что не удивительно, что бедный Google вынужден был сделать AlphaFold общедоступным; попробуй он его продать, его бы с потрохами сожрали.

Учёные - люди очень вежливые, и никто, если я правильно помню, публично и нецензурно на эту тему не высказался. Но на конференциях и прочих проф обсуждениях биологи периодически делают 🤦🏻♀️🤦🏻♀️🤦🏻♀️. Правда, тут же добавляя, что AlphaFold - это хорошо, это первый шаг ТМ и прочее в том же духе.

Люблю такое.

👍3

This media is not supported in your browser

VIEW IN TELEGRAM

А кто у нас в нейронках шарит?

Тегмарк опубликовал статью, дескать в сетке образуются (пространственные и временные) нейроны, отвечающие за формирование модели мира

Но

Это разве не натягивание совы на глобус?

Под его определение модели мира можно чуть ли ни все притянуть, не? «coherent model of the data generating process -- a world model»

Вот как вы считаете, в нейронках распознавания лиц репрезентации конкретных персон можно же тоже отнести к построению модели мира нейронками? (тк нейронки выделяют уникальные объекты в мире, и какая разница - это континенты или время (= последовательность событий друг за другом) или люди итп)

Ну то есть уникальные люди для него не модель мира, а континенты - модель мира. Выглядит как bias, не? )

Тегмарк опубликовал статью, дескать в сетке образуются (пространственные и временные) нейроны, отвечающие за формирование модели мира

Но

Это разве не натягивание совы на глобус?

Под его определение модели мира можно чуть ли ни все притянуть, не? «coherent model of the data generating process -- a world model»

Вот как вы считаете, в нейронках распознавания лиц репрезентации конкретных персон можно же тоже отнести к построению модели мира нейронками? (тк нейронки выделяют уникальные объекты в мире, и какая разница - это континенты или время (= последовательность событий друг за другом) или люди итп)

Ну то есть уникальные люди для него не модель мира, а континенты - модель мира. Выглядит как bias, не? )

👍2❤🔥1🤯1

Тут интересная рефлексия о макро-трансформации VC за последние декады от Scott Galloway, что супер-много денег в late stage и задерживание в выводе компаний на public markets с целью закепчурить весь апсайд превратили tech IPOs в подобие ICO:

- 10 лет назад было 39 unicorns, сейчас 1221

- Последние 3 г. post-IPO performance -50%

- В 1980 г 78% IPO были прибыльные компании, в 2021 - 10%

- За 40 лет доля free float упала с 30% до 15% - нужно для искусственного создания scarcity и выше спроса на акции в IPO

- Который удовлетворялся в тч и direct deals до IPO

- Это сопровождалось раскруткой хайпов для ритейл инвесторов всеми в тч Robinhood и CNBC

- В 1981 г два класса акций были у 3% IPO, а сейчас 50% tech так делают

- Супербольшие VC задерживают IPO до тех пор пока the company is strong but mature & the returns from its growth phase are fully harvested, or its model is suspect & existing shareholders need to deploy a series of false signals to greater fools so they can fling feces at tourists to the unicorn zoo

- 10 лет назад было 39 unicorns, сейчас 1221

- Последние 3 г. post-IPO performance -50%

- В 1980 г 78% IPO были прибыльные компании, в 2021 - 10%

- За 40 лет доля free float упала с 30% до 15% - нужно для искусственного создания scarcity и выше спроса на акции в IPO

- Который удовлетворялся в тч и direct deals до IPO

- Это сопровождалось раскруткой хайпов для ритейл инвесторов всеми в тч Robinhood и CNBC

- В 1981 г два класса акций были у 3% IPO, а сейчас 50% tech так делают

- Супербольшие VC задерживают IPO до тех пор пока the company is strong but mature & the returns from its growth phase are fully harvested, or its model is suspect & existing shareholders need to deploy a series of false signals to greater fools so they can fling feces at tourists to the unicorn zoo

👍4